La necessità e la domanda di dati generati dagli utenti nel dinamico mondo degli affari di oggi è in costante aumento e anche la moderazione dei contenuti sta guadagnando sufficiente attenzione.

Che si tratti di post sui social media, recensioni di prodotti o commenti sul blog, i dati generati dagli utenti generalmente offrono un modo più coinvolgente e autentico di promuovere il marchio. Sfortunatamente, questi dati generati dagli utenti non sono sempre degli standard più elevati e pongono la sfida di un’efficace moderazione dei contenuti.

La moderazione dei contenuti basata sull'intelligenza artificiale garantisce che i tuoi contenuti siano in linea con gli obiettivi previsti dall'azienda e promuova un ambiente online sicuro per gli utenti. Diamo quindi un'occhiata al variegato panorama della moderazione dei contenuti ed esploriamo le sue tipologie e il suo ruolo nell'ottimizzazione dei contenuti per i marchi.

Moderazione dei contenuti AI: una panoramica approfondita

La moderazione dei contenuti AI è un processo digitale efficace che sfrutta le tecnologie AI per monitorare, filtrare e gestire i contenuti generati dagli utenti su varie piattaforme digitali.

La moderazione dei contenuti mira a garantire che i contenuti pubblicati dagli utenti siano conformi agli standard della comunità, alle linee guida della piattaforma e alle normative legali.

La moderazione dei contenuti prevede lo screening e l'analisi di testi, immagini e video per identificare e affrontare le aree problematiche.

Il processo di moderazione dei contenuti risolve molteplici scopi, come ad esempio

- Filtrare contenuti inappropriati o dannosi

- Ridurre al minimo i rischi legali

- Mantenere la sicurezza del marchio

- Migliorare la velocità, la coerenza e la scalabilità aziendale

- Migliorare l'esperienza dell'utente

Andiamo un po' più a fondo ed esploriamo la moderazione dei contenuti in modo più vivido con i suoi diversi tipi e il suo ruolo in essi:

[Leggi anche: Comprendere la moderazione automatizzata dei contenuti]

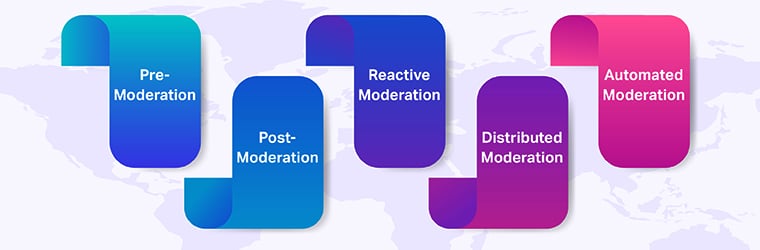

Uno sguardo al percorso di moderazione dei contenuti: 5 fasi chiave

Ecco le cinque fasi chiave che i dati attraversano prima di assumere la forma e la forma corrette:

Pre-moderazione

Implica la revisione e l'approvazione del contenuto prima che venga pubblicato su una piattaforma. Questo metodo offre uno stretto controllo sui contenuti e garantisce che vengano pubblicati solo i contenuti che soddisfano specifiche linee guida aziendali. Sebbene questo metodo sia molto efficace nel generare contenuti di alta qualità, può rallentarne la distribuzione poiché richiede una revisione e un'approvazione umane coerenti.

Esempio del mondo reale:

Amazon è un marchio popolare che utilizza la moderazione dei contenuti per garantire l'adeguatezza dei propri contenuti. Poiché Amazon fornisce regolarmente migliaia di immagini e video di prodotti, il suo strumento Amazon Rekognition garantisce che il contenuto venga convalidato. Utilizza il metodo di pre-moderazione per rilevare contenuti espliciti di oltre l'80% che potrebbero danneggiare la reputazione dell'azienda.

Post moderazione

A differenza della pre-moderazione, la post-moderazione consente agli utenti di inviare contenuti in tempo reale senza necessità di revisione preventiva. Ciò significa che il contenuto viene immediatamente distribuito sul server live ma è soggetto a ulteriore revisione. Questo approccio consente una distribuzione più rapida dei contenuti. Tuttavia, la post-moderazione comporta anche il rischio di pubblicazione di contenuti inappropriati o dannosi.

Esempio del mondo reale:

YouTube ne è un classico esempio. Consente ai suoi utenti di pubblicare e pubblicare prima il contenuto. Successivamente, esamina i video e li segnala per inadeguatezza o problemi di copyright.

Moderazione reattiva

È un'ottima tecnica utilizzata da alcune comunità online per segnalare qualsiasi contenuto inappropriato. La moderazione reattiva viene generalmente utilizzata con il metodo pre o post moderazione e si basa sulle segnalazioni degli utenti o sui sistemi di segnalazione automatizzati per identificare ed esaminare le violazioni dei contenuti. Le comunità online si avvalgono di più moderatori che valutano e intraprendono le azioni necessarie per eliminare i dati inappropriati identificati.

Esempio del mondo reale:

Facebook utilizza il metodo della moderazione reattiva per vagliare i contenuti presenti sulla propria piattaforma. Consente ai suoi utenti di segnalare qualsiasi contenuto inappropriato e, sulla base delle recensioni collettive, implementa ulteriormente le azioni richieste. Recentemente, Facebook ha sviluppato un'intelligenza artificiale per la moderazione dei contenuti che offre una percentuale di successo superiore al 90% nella segnalazione dei contenuti.

Moderazione distribuita

Questo metodo si basa sulla partecipazione degli utenti per valutare il contenuto e determinare se è adatto al marchio o meno. Gli utenti votano su qualsiasi scelta suggerita e la valutazione media decide quale contenuto verrà pubblicato.

L’unico svantaggio dell’utilizzo della moderazione distribuita è che incorporare questo meccanismo nei marchi è molto impegnativo. Affidarsi agli utenti per moderare i contenuti comporta una serie di rischi legali e di branding.

Esempio del mondo reale:

wikipedia utilizza il meccanismo di moderazione della distribuzione per mantenere l'accuratezza e la qualità dei contenuti. Incorporando vari editor e amministratori, il team Wikipedia garantisce che solo i dati giusti vengano caricati sul sito web.

Moderazione automatizzata

È una tecnica semplice ma efficace che utilizza filtri avanzati per catturare parole da un elenco e agire ulteriormente su regole preimpostate per filtrare i contenuti. Gli algoritmi utilizzati nel processo identificano modelli che solitamente generano contenuti potenzialmente dannosi. Questo metodo pubblica in modo efficiente contenuti ottimizzati che possono generare maggiore coinvolgimento e traffico sul sito web.

Esempio del mondo reale

La moderazione automatizzata viene utilizzata da vari piattaforme di gioco, incluse PlayStation e Xbox. Queste piattaforme incorporano metodi automatizzati che rilevano e puniscono i giocatori che violano le regole del gioco o utilizzano cheat code.

Casi d'uso basati sull'intelligenza artificiale nella moderazione dei contenuti

La moderazione dei contenuti consente la rimozione dei seguenti tipi di dati:

- Contenuti espliciti per 18+: Si tratta di contenuti sessualmente espliciti che includono nudità, volgarità o atti sessuali.

- Contenuti aggressivi: Si tratta di contenuti che rappresentano minacce, molestie o contengono linguaggio dannoso. Può includere anche prendere di mira individui o gruppi e spesso violare le linee guida della community.

- Contenuti con linguaggio inappropriato: Si tratta di contenuti che contengono linguaggio offensivo, volgare o inappropriato, come parolacce e insulti che potrebbero ledere i sentimenti di qualcuno.

- Contenuti ingannevoli o falsi: Sono le false informazioni diffuse intenzionalmente per disinformare o manipolare il pubblico.

La moderazione dei contenuti AI garantisce che tutti questi tipi di contenuto vengano recuperati ed eliminati per fornire contenuti più accurati e affidabili.

Affrontare la diversità dei dati utilizzando la moderazione dei contenuti

I contenuti sono presenti in vari tipi e forme nei media digitali. Pertanto, ogni tipo richiede un approccio specializzato di moderazione per acquisire risultati ottimali:

[Leggi anche: 5 tipi di moderazione dei contenuti e come scalare utilizzando l'intelligenza artificiale?]

Dati di testo

Per i dati di testo, la moderazione del contenuto viene eseguita utilizzando gli algoritmi NLP. Questi algoritmi utilizzano sentiment analysis per identificare il tono di un dato contenuto. Analizzano il contenuto scritto e rilevano eventuali spam o contenuti dannosi.

Inoltre, utilizza anche il riconoscimento delle entità, che sfrutta i dati demografici dell’azienda per prevedere la falsità dei contenuti. In base ai modelli identificati, il contenuto viene contrassegnato come sicuro o non sicuro e può essere ulteriormente pubblicato.

Dati vocali

La moderazione dei contenuti vocali ha recentemente acquisito un valore immenso con l'avvento degli assistenti vocali e dei dispositivi ad attivazione vocale. Per moderare con successo il contenuto vocale, viene sfruttato un meccanismo noto come analisi vocale.

L'analisi vocale è alimentata dall'intelligenza artificiale e fornisce:

- Traduzione della voce in testo.

- Analisi del sentiment del contenuto.

- Interpretazione del tono della voce.

Dati immagine

Quando si tratta di moderare il contenuto delle immagini, tecniche come la classificazione del testo, l'elaborazione delle immagini e la ricerca basata sulla visione tornano utili. Queste potenti tecniche analizzano a fondo le immagini e rilevano eventuali contenuti dannosi nell'immagine. L'immagine viene inviata per la pubblicazione se non contiene contenuti dannosi o viene contrassegnata nel caso alternativo.

Dati video

La moderazione video richiede l'analisi dell'audio, dei fotogrammi video e del testo all'interno dei video. Per fare ciò, utilizza gli stessi meccanismi sopra menzionati per testo, immagine e voce. La moderazione video garantisce che i contenuti inappropriati vengano rapidamente identificati e rimossi per creare un ambiente online sicuro.

Conclusione

La moderazione dei contenuti basata sull'intelligenza artificiale è un potente strumento per mantenere la qualità e la sicurezza dei contenuti su vari tipi di dati. Poiché i contenuti generati dagli utenti continuano a crescere, le piattaforme devono adattarsi a nuove ed efficaci strategie di moderazione in grado di aumentare la credibilità e la crescita del proprio business. Potresti mettiti in contatto con il nostro team Shaip se sei interessato alla moderazione dei contenuti per la tua attività.