Caso di studio: moderazione dei contenuti

Oltre 30 documenti Web eliminati e annotati per la moderazione dei contenuti

che si sforzano di proteggere lo spazio online in cui ci connettiamo e comunichiamo.

Man mano che l'utilizzo dei social media continua a crescere, il

problema del cyberbullismo è emerso come a

ostacolo significativo per le piattaforme che si sforzano di farlo

garantire uno spazio online sicuro. Uno sbalorditivo

Il 38% delle persone incontra questo

comportamenti dannosi su base giornaliera,

sottolineando l'urgente richiesta di inventiva

approcci di moderazione dei contenuti.

Le organizzazioni oggi si affidano all'uso di

intelligenza artificiale per affrontare il duraturo

problema del cyberbullismo in modo proattivo.

Sicurezza informatica:

Il rapporto sull'applicazione degli standard della comunità del quarto trimestre di Facebook ha rivelato: azione su 4 milioni di contenuti di bullismo e molestie, con un tasso di rilevamento proattivo del 6.3%

Educazione:

A 2021 lo studio lo ha scoperto 36.5%% degli studenti negli Stati Uniti di età compresa tra 12 & 17 anni hanno sperimentato il cyberbullismo in un momento o nell'altro durante la scuola.

Secondo un rapporto del 2020, il mercato globale delle soluzioni di moderazione dei contenuti era valutato a 4.07 miliardi di dollari nel 2019 e si prevedeva che raggiungesse gli 11.94 miliardi di dollari entro il 2027, con un CAGR del 14.7%.

Soluzione del mondo reale

Dati che moderano le conversazioni globali

Il cliente stava sviluppando un robusto sistema automatizzato

moderazione dei contenuti Apprendimento automatico

modello per la sua offerta Cloud, per la quale essi

stavamo cercando un fornitore specifico del dominio who

potrebbe aiutarli con dati di addestramento accurati.

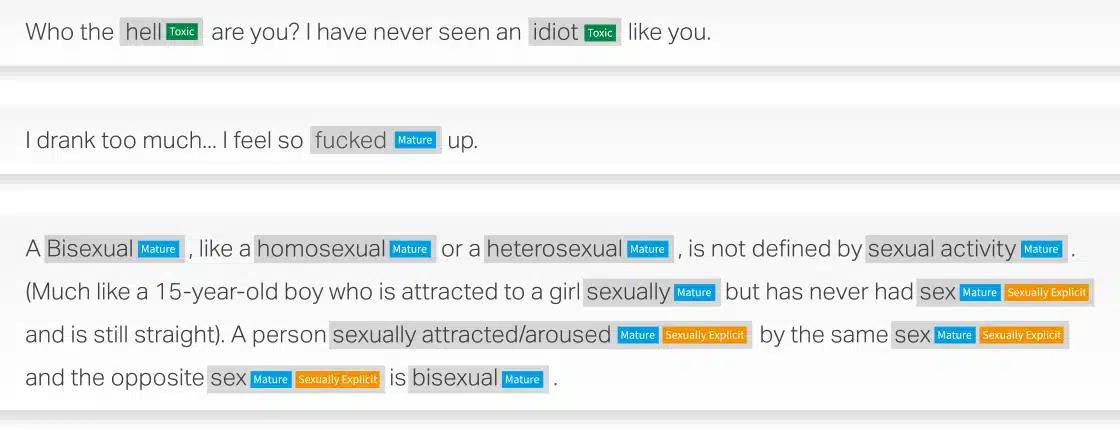

Sfruttando la nostra vasta conoscenza nell'elaborazione del linguaggio naturale (NLP), abbiamo assistito il cliente nella raccolta, categorizzazione e annotazione di oltre 30,000 documenti sia in inglese che in spagnolo per creare un modello di machine learning di moderazione automatica dei contenuti suddiviso in contenuti tossici, maturi o sessualmente espliciti categorie.

Problema

- Web scraping di 30,000 documenti sia in spagnolo che in inglese da domini prioritari

- Classificazione dei contenuti raccolti in segmenti brevi, medi e lunghi

- Etichettare i dati raccolti come contenuti tossici, maturi o sessualmente espliciti

- Garantire annotazioni di alta qualità con una precisione minima del 90%.

Soluzione

- Web Eliminati 30,000 documenti ciascuno per spagnolo e inglese da BFSI, Healthcare, Manufacturing, Retail. Il contenuto è stato ulteriormente suddiviso in documenti brevi, medi e lunghi

- Etichettare con successo il contenuto classificato come tossico, per adulti o sessualmente esplicito

- Per ottenere una qualità del 90%, Shaip ha implementato un processo di controllo della qualità a due livelli:

» Livello 1: Quality Assurance Check: 100% dei file da convalidare.

» Livello 2: controllo critico dell'analisi della qualità: il team CQA di Shaips valuterà il 15%-20% dei campioni retrospettivi.

Risultato

I dati di addestramento hanno aiutato a creare un modello ML di moderazione dei contenuti automatizzato che può produrre diversi risultati utili per mantenere un ambiente online più sicuro. Alcuni dei risultati chiave includono:

- Efficienza per elaborare una vasta quantità di dati

- Coerenza nel garantire l'applicazione uniforme delle politiche di moderazione

- Scalabilità per adattarsi alla crescente base di utenti e volumi di contenuti

- La moderazione in tempo reale può identificare e

rimuovere i contenuti potenzialmente dannosi non appena vengono generati - Rapporto costo-efficacia riducendo la dipendenza dai moderatori umani

Esempi di moderazione dei contenuti

Raccontaci come possiamo aiutarti con la tua prossima iniziativa di intelligenza artificiale.